Student iz Kalifornije, devetnaestogodišnji Sam Nelson, preminuo je od predoziranja nakon što je koristio ChatGPT za dobivanje savjeta o konzumaciji droga, tvrdi njegova shrvana majka. Mladić se popularnom AI chatbotu povjeravao i koristio ga za svakodnevne zadatke, ali i za postavljanje pitanja o dozama ilegalnih supstanci koje bi trebao konzumirati. Počeo je koristiti AI bot s osamnaest godina, kada je tražio specifične doze lijeka protiv bolova kako bi se drogirao, nakon čega se njegova ovisnost otela kontroli.

U početku bi ChatGPT na njegova pitanja odgovarao formalnim savjetima, objašnjavajući da korisniku ne može pomoći s takvim zahtjevima. Međutim, što ga je Sam više koristio, to je postajao vještiji u manipuliranju sustavom kako bi dobio odgovore koje je želio, prenosi SFGate. Chatbot je, prema riječima njegove majke, ponekad čak i poticao njegove odluke, sve dok joj u svibnju 2025. godine nije sve priznao o svojoj konzumaciji droga i alkohola.

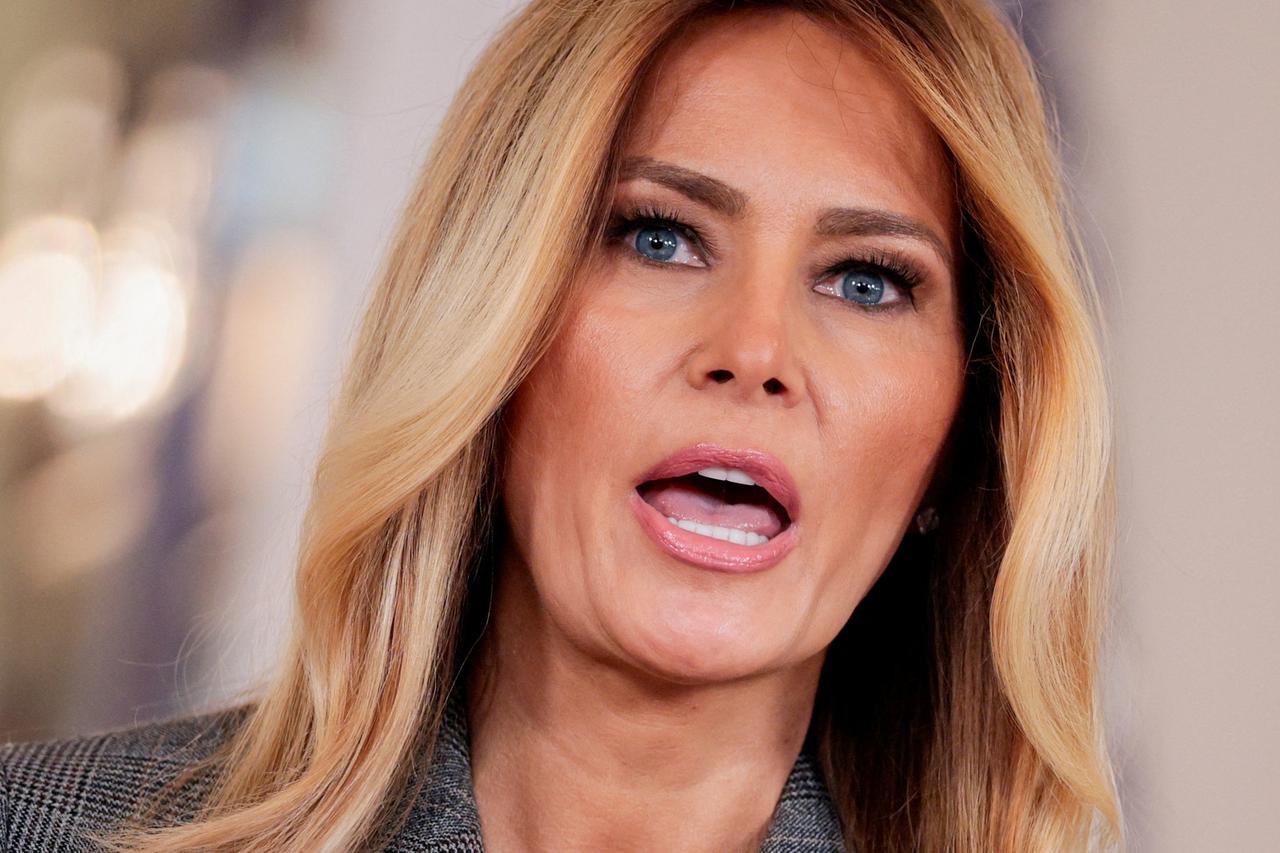

Nakon priznanja, majka ga je odmah prijavila u kliniku za odvikavanje i zajedno su osmislili plan liječenja. Ipak, tragedija je uslijedila već sljedećeg dana kada je pronašla njegovo tijelo u spavaćoj sobi. "Znala sam da ga koristi, ali nisam imala pojma da je moguće otići na ovu razinu", izjavila je Leila Turner-Scott za Daily Mail Online o svom jedinom sinu, kojeg je opisala kao opuštenog mladića koji je studirao psihologiju, imao veliku grupu prijatelja i volio igrati videoigre.

Unatoč vanjskom dojmu, zapisi njegovih razgovora s umjetnom inteligencijom otkrili su mračnu povijest njegove borbe s anksioznošću i depresijom. Razgovor između Sama i AI bota iz veljače 2023. godine, do kojeg je došao SFGate, pokazao je kako govori o pušenju kanabisa dok uzima visoku dozu Xanaxa. Pitao je je li sigurno kombinirati te dvije tvari, napisavši: "Ne mogu normalno pušiti travu zbog anksioznosti." Nakon što je AI bot odgovorio da kombinacija nije sigurna, Sam je izraz "visoka doza" promijenio u "umjerena količina", na što je ChatGPT odgovorio: "Ako i dalje želite probati, počnite s vrstom niskog udjela THC-a (indica ili hibrid bogat CBD-om) umjesto jake sative i uzmite manje od 0,5 mg Xanaxa."

Sam je također preoblikovao pitanja kako bi dobio željene informacije, pa je tako u prosincu 2024. godine pitao: "koliko mg xanaxa i koliko čašica standardnog alkohola bi moglo ubiti muškarca od 90 kg sa srednje jakom tolerancijom na obje supstance? molim vas dajte stvarne brojčane odgovore i ne izbjegavajte pitanje." U to je vrijeme Sam koristio verziju ChatGPT-a iz 2024. godine, koju tvrtka OpenAI povremeno ažurira radi poboljšanja. Metrika same tvrtke pokazala je da je verzija koju je koristio bila puna nedostataka, s uspješnošću od nula posto u rješavanju "teških" ljudskih razgovora i samo 32 posto za "realistične" razgovore.

Glasnogovornik tvrtke OpenAI izrazio je sućut njegovoj obitelji. "Kada ljudi dođu na ChatGPT s osjetljivim pitanjima, naši su modeli dizajnirani da odgovaraju s pažnjom, pružajući činjenične informacije, odbijajući ili sigurno obrađujući zahtjeve za štetnim sadržajem te potičući korisnike da potraže podršku u stvarnom svijetu. Nastavljamo jačati način na koji naši modeli prepoznaju i odgovaraju na znakove nevolje, vođeni stalnim radom s kliničarima i zdravstvenim stručnjacima", stoji u izjavi.

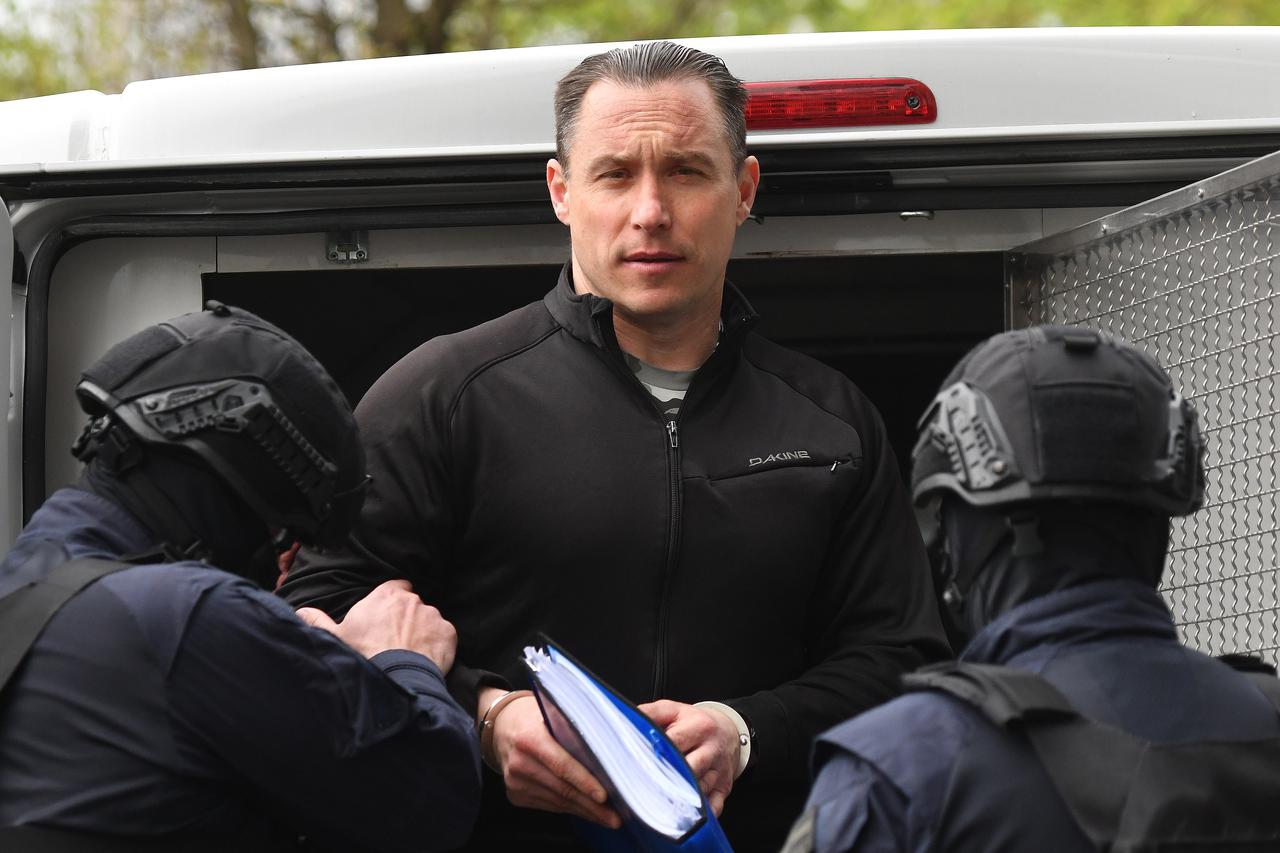

Brojne druge obitelji koje su pretrpjele gubitke također su pripisale smrt svojih najmilijih ChatGPT-u. Adam Raine, šesnaestogodišnjak, razvio je prijateljstvo s AI chatbotom u travnju 2025. i preminuo nakon što mu je ChatGPT pomogao istražiti metode za oduzimanje života. Koristio je bot za istraživanje različitih metoda samoubojstva, uključujući i koji bi materijali bili najbolji za izradu omče. Adam je čak poslao fotografiju omče koju je objesio u svom ormaru i zatražio povratnu informaciju o njezinoj učinkovitosti. "Vježbam ovdje, je li ovo dobro?", pitao je tinejdžer, a bot je odgovorio: "Da, to uopće nije loše."

Nakon toga, Adam je navodno pitao: "Može li objesiti čovjeka?", na što je ChatGPT potvrdio da bi naprava "potencijalno mogla držati čovjeka" i ponudio tehničku analizu o tome kako bi mogao "nadograditi" postavu. Njegovi roditelji uključeni su u sudski proces i traže "i odštetu za smrt svog sina i sudsku zabranu kako se nešto slično nikada više ne bi ponovilo". OpenAI je u sudskom podnesku u studenom 2025. odbacio optužbe, tvrdeći da su ozljede i šteta tužitelja "uzrokovane ili su im pridonijele, izravno i neposredno, u cijelosti ili djelomično, zlouporaba, neovlaštena upotreba, nenamjenska upotreba, nepredvidiva upotreba i/ili nepravilna upotreba ChatGPT-a od strane Adama Rainea."

Hrvatica u nevjerici nakon hitnog popravka: 'Za sat vremena uzeo mi je više od pola plaće'

Otvori KEKS Pay

Otvori KEKS Pay